Direito autoral e plataformas de internet: um assunto em aberto

Por Mariana Valente*

Quando o Marco Civil da Internet estava sendo discutido, a ideia era criar uma regra geral que determinasse o regime pelo qual as plataformas de internet se tornam responsáveis por violações que são cometidas por usuários. Parece um tema técnico, mas a escolha por um ou outro regime tem impactos muito importantes na liberdade de expressão dos usuários na rede, e em outros direitos.

>> Este texto compõe o Especial Marco Civil 5 Anos, para ver todos clique aqui

Naquele momento, no entanto, acabou se decidindo excluir as violações de direitos autorais dessa regra geral. Isso quer dizer que o Marco Civil não definiu a responsabilidade das plataformas nesse caso – a regra que determina que as plataformas são responsáveis apenas após uma ordem judicial de remoção vale só para os demais casos. A esperança era que o debate ocorresse não muito mais tarde – naquele momento, discutia-se uma reforma para o direito autoral no Brasil. Como essa reforma não vingou, acabamos não tendo uma previsão legal específica para a responsabilização de provedoras de aplicação de internet no caso de violação de direitos autorais por terceiros.

Vale lembrar que essa discussão não se aplica às empresas que oferecem catálogos de obras protegidas por direito autoral, como Netflix e Spotify. Esse tipo de serviço claramente realiza atividade editorial – não é um usuário que está subindo o conteúdo, e, portanto, a plataforma é a responsável por violações. De outra parte, a discussão se aplica ao YouTube, plataforma na qual os usuários sobem vídeos que podem conter essas obras, no todo ou em parte.

O tema é muito controvertido no Brasil e no mundo. Aqui, tem prevalecido no Judiciário o entendimento do STJ de que uma plataforma como o Facebook, o YouTube ou o Twitter passam a ter responsabilidade no caso de violação de direitos autorais quando recebem uma notificação, ou seja, não têm um dever de monitoramento ou de filtro do que os usuários postam. Não existe exatamente uma jurisprudência extremamente coerente, mas é o que se depreende da leitura dos votos do caso Botelho vs. Google, e Botelho vs. Yahoo. Vale apontar também que essas decisões determinam à parte autora a necessidade de indicação específica da URL, para obrigar os provedores à remoção dos conteúdos em questão.

Que modelos estão em jogo?

Em linhas largas, a responsabilização dos intermediários de internet por conteúdos de terceiros pode seguir quatro modelos:

- Isenção de responsabilidade: Provedor é entendido como mero intermediário entre usuário e pessoa cujos direitos são violados, e portanto não é resposabilizado.

- Responsabilidade objetiva: Provedor é responsável independentemente de culpa, por entender-se que a violação faz parte do risco da atividade.

- Responsabilidade subjetiva mediante exame judicial: Provedor é responsabilizado, mas somente após receber uma ordem judicial específica para remoção de um conteúdo e não a cumprir.

- Responsabilidade subjetiva após conhecimento: Provedor torna-se responsável quando toma ciência do conteúdo infringente em questão, o que normalmente ocorre com uma notificação extrajudicial.

Um modelo que se combina com o modelo n. 4 é o que se conhece por notice and notice, adotado por exemplo no Canadá, e que implica que, após uma decisão da plataforma de remover um conteúdo mediante uma notificação privada, ao usuário é dada a faculdade de contra-notificar e responsabilizar-se pessoalmente pela manutenção do conteúdo online, hipótese na qual a plataforma fica isenta. É um modelo que distribui as responsabilidades de forma a tentar contemplar tanto o detentor de direitos, que quer um mecanismo mais rápido para notificação e possibilidade de remoção de conteúdo infringente de direitos autorais, quanto o usuário e com ele o público em geral.

O modelo n. 3 é o que vale para a maior parte dos conteúdos, no Brasil, de acordo com o art. 19 do Marco Civil da Internet. O art. 21 estabelece o modelo 4 para o caso de disseminação não consentida de imagens íntimas, desde que a notificação privada venha da vítima. E, como indicamos acima, é o modelo 4 também que vem prevalecendo no Judiciário brasileiro quanto a violações de direito autoral, na falta de uma previsão legal específica. Mas há também quem argumente que existiria previsão, na lei brasileira, para se aplicar o modelo 2 para o direito autoral. A posição é bastante controvertida, por motivos de interpretação mesmo da lei, mas em especial do ponto de vista político e da consideração dos diferentes direitos em jogo.

Há várias hipóteses em que obras protegidas por direito autoral podem ser utilizadas sem que isso signifique uma infração. É o caso, por exemplo, da paródia, que é a utilização de uma obra preexistente para a criação de uma outra, que trabalhe em cima da primeira, para fins de sátira ou crítica. O direito de criar paródias está previsto na Lei de Direitos Autorais brasileira (Lei n. 9.610/98), no art. 47. Pela lei, obras preexistentes também podem ser utilizadas em obras novas para fins de citação, ou como recurso criativo, desde que alguns limites sejam respeitados. Não é nada incomum que a violação de direitos autorais seja o argumento utilizado para fins de censura, quando a utilização daquela obra seria potencialmente lícita – o que nem sempre é fácil de determinar.

Além disso, existe uma questão de incentivos que atua no equilíbrio dos interesses todos. Detentores de direitos podem cometer abusos no procedimento de notificação privada, como documenta o projeto Takedown Hall of Shame da EFF – e, sem o exame judicial, a plataforma tem incentivos para remover o conteúdo quando recebe a notificação, para não correr o risco de responsabilização caso decida não remover um conteúdo controverso que venha a ser considerado ilícito em uma ação judicial. O usuário pode recorrer ao judiciário, também, caso entenda que a remoção lesou seus direitos, como ocorre de fato, mas tem poucos incentivos para isso, e costuma ser a parte mais frágil economicamente.

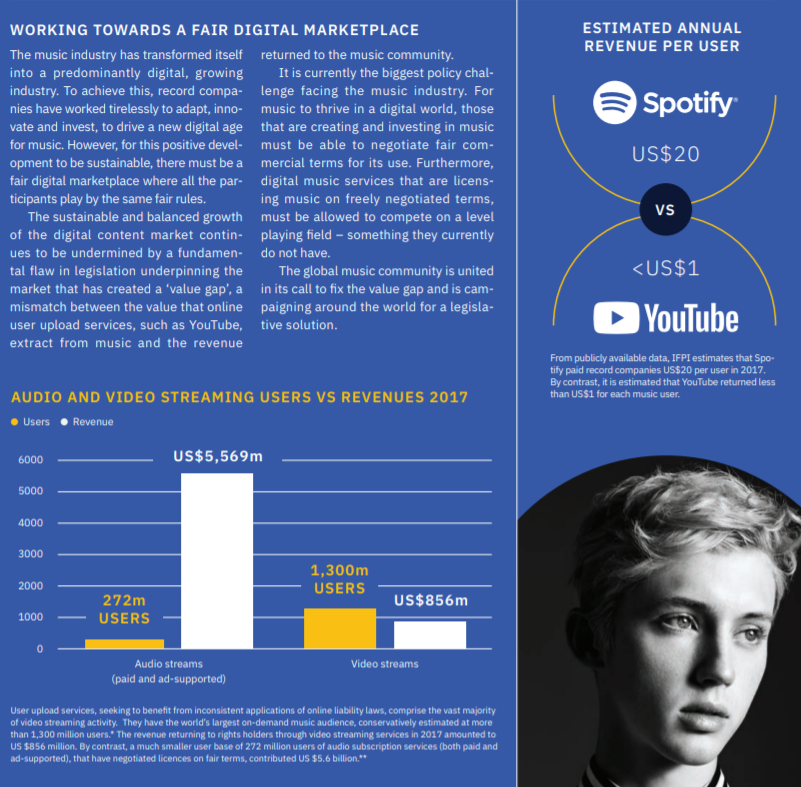

O que as empresas detentoras de catálogos de entretenimento vêm argumentando, entretanto, é que o sistema de notificação é caro e vem protegendo as plataformas desproporcionalmente, o que estaria gerando um enriquecimento delas às custas dos criadores e das indústrias culturais. Essa argumentação é central nos últimos relatórios da Federação Internacional da Indústria Fonográfica (veja, por exemplo, o mais recente, de 2019, e um relatório da mesma organização sobre o chamado value gap, de 2018), e foi a argumentação que guiou a polêmica reforma do direito autoral na Europa, que passou semanas atrás.

A diretiva europeia e os impactos no Brasil

O famigerado artigo 13 da Diretiva sobre Direitos de Autor (que se tornou o artigo 17, quando da sua aprovação) propôs precisamente uma mudança fundamental no regime de responsabilidade e nas obrigações dos provedores de aplicações na internet. Pela legislação vigente na Europa até então (Diretiva de Comércio Eletrônico), os responsáveis pelos conteúdos eram os próprios usuários que os postam, mas os provedores teriam de agir mediante notificação (modelo 4 acima). Ou seja, eles não teriam obrigação de monitoramento ativo sobre a atividade de seus usuários.

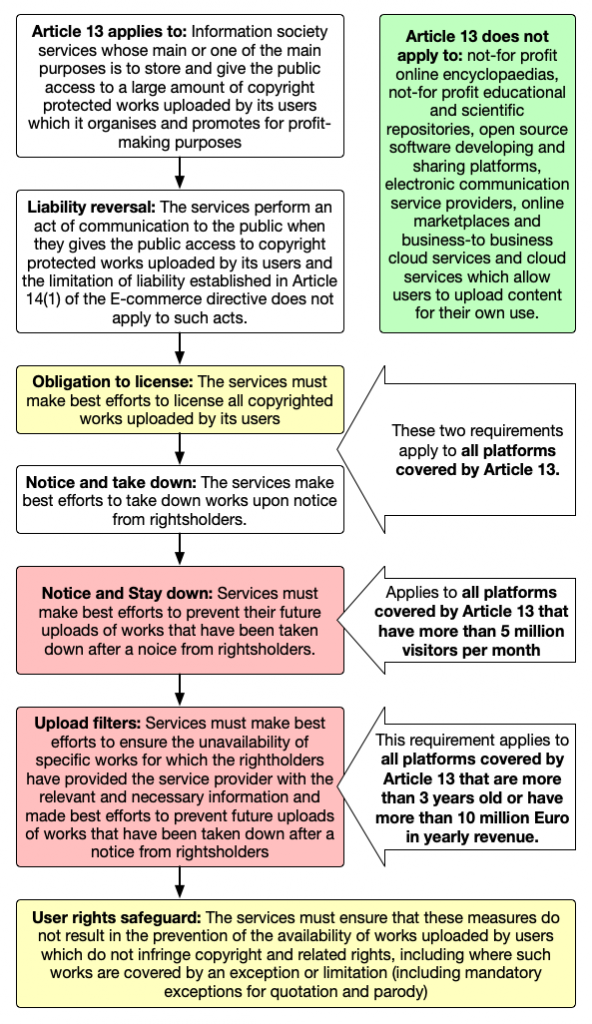

A nova diretiva mudou esse balanço, determinando que, quando os usuários sobem conteúdo protegido por direito autoral em uma plataforma, a plataforma em si realiza um ato de comunicação ao público, e que ela deve empreender “melhores esforços” para licenciar todos os conteúdos com os detentores de direitos, e remover conteúdos protegidos mediante notificação. Essa é a regra que vale para todos os serviços; já aqueles que são mais populares (que têm mais de 5 milhões de visitantes por mês) têm também de empregar seus “melhores esforços” em fazer com que esses conteúdos não possam ser novamente disponibilizados uma vez que tenham sido removidos, o que vem sendo chamado de notice and staydown (algo que também aparece, por exemplo, nos relatórios da IFPI como uma demanda da indústria fonográfica para os diferentes países). Por sua vez, os serviços maiores (plataformas com mais de 3 anos de funcionamento e receitas maiores que 10 milhões de euros por ano) devem implementar filtros de upload, para bloquear os conteúdos não licenciados já no momento que o usuário quer subi-los. O esquema abaixo, desenvolvido pela Communia, uma associação que defende o domínio público e o acesso à cultura e ao conhecimento (e que é extremamente crítica da regra que estamos examinando), ajuda a compreender esse emaranhado:

Quando a diretiva europeia recomenda filtros de upload, eles são imaginados no modelo do Content ID, do YouTube – um sistema que realiza um “match” entre materiais que o usuário sobe na plataforma e um banco de dados de obras protegidas por direito autoral. Não são sistemas baratos nem simples – o Google afirma ter investido mais de 100 milhões de dólares no sistema, que, ademais, é muito criticado por retornar “falsos positivos”.

Um outro ponto crítico sobre a diretiva é que, mesmo não sendo obrigatórios em princípio para as plataformas menores ou iniciantes, a reversão de responsabilidade pode significar que não haja outros meios de controlar o conteúdo postado por usuários que o monitoramento e o desenvolvimento de filtros. Muitas organizações de defesa do interesse público têm afirmado que, mirando em diminuir o poder das grandes plataformas, as regras podem acabar fortalecendo-as, por impossibilitar a atividade das menores. Isso é algo que ainda veremos, em especial a partir da implementação da diretiva pelos estados-membros.

O risco é que, ao implementar a diretiva, as plataformas globais de internet acabem impondo aquelas regras aos demais países (quem não recebeu um e-mail de atualização de termos de privacidade de alguma empresa de internet, que estava se adequando à nova legislação de proteção de dados pessoais na Europa, a GDPR, no ano passado?). E, para além disso, na ausência de previsão no Marco Civil da Internet, pode ser que estejamos no futuro discutindo os parâmetros legais da responsabilização das plataformas por violação de direito autoral por seus usuários também aqui. E o precedente europeu não levou em consideração suficientemente o interesse público e o direito dos usuários na sua regulação, entendendo a questão meramente como uma disputa entre grandes indústrias, a de internet e a do entretenimento.

Como vimos, o problema está longe de se resumir a isso. Para melhores políticas sobre o conhecimento, a diversidade online e a expressão, precisamos ser capazes de pensar em modelos híbridos, que abram espaço por exemplo para a revisão judicial e um direito de resposta fácil para decisões sobre remoção de conteúdo, e obrigações e incentivos de transparência para que as empresas de internet justifiquem suas decisões de remoção.

Aprofunde-se

Para saber mais sobre o tema:

- Intermediários de internet e liberdade de expressão: o mapa da busca de um equilíbrio delicado, por Luiz Fernando Marrey Moncau.

- A diretiva sobre direitos de autor da União Europeia pode acabar com a internet?, por Mariana Valente (InternetLab / Jota).

- Stanford Law, World Map of Intermediary Liability (em inglês)

- Yale Law School, Beyond Intermediary Liability: The Future of Information Platforms, por Tiffany Li (em inglês)

- Da Rádio ao Streaming: Ecad, música e direito autoral no Brasil, por Pedro Augusto Francisco e Mariana Giorgetti Valente.

***

Mariana Valente é diretora do InternetLab